Da der Support für Windows 10 offiziell im Oktober 2025 endet, upgraden viele Benutzer auf Windows 11, um mit Sicherheitsupdates geschützt zu bleiben. Einige könnten jedoch überrascht sein, einen neuen KI-Begleiter vorzufinden, der auf sie wartet: Copilot.

Positioniert als Microsofts ehrgeizigster Vorstoß in die generative KI, ist Copilot nun tief in Windows 11, Edge, Bing und die Microsoft 365-Suite integriert. Es ist das Herzstück von Microsofts milliardenschwerer Partnerschaft mit OpenAI (dem Schöpfer von ChatGPT und ChatGPT Atlas), deren GPT-Modelle Copilots Intelligenz antreiben. Kombiniert mit der Einführung von Copilot+ PCs – ausgestattet mit einer dedizierten Copilot-Taste – zeigt dies alles, wie ernst es Microsoft damit ist, Windows in eine KI-gestützte Zukunft zu lenken.

Jedoch heißt nicht jeder diesen allgegenwärtigen Helfer willkommen, der an Clippy erinnert, aber weitaus hartnäckiger ist. Die enge Integration von Copilot wirft Bedenken hinsichtlich Privatsphäre und Sicherheit auf, ähnlich wie als das zu Microsoft gehörende LinkedIn begann, KI unter Verwendung öffentlicher Profile und Aktivitätsdaten zu trainieren, oder als Googles Plan, seinen KI-Assistenten Gemini tief in Android einzubetten, um Google Assistant zu ersetzen.

Nur Unternehmensbenutzer von Microsoft 365 und IT-Administratoren können Copilot vollständig aus Windows 11 entfernen. In allen anderen Fällen – wie bei Benutzern mit persönlichen oder Familien-Abonnements oder gar keinem Microsoft 365-Abonnement – gibt es nur Möglichkeiten, seine Funktionen einzuschränken und seine Sichtbarkeit zu verringern.

- Wie man Copilot-KI ausschaltet

- Wie man Microsoft 365 Copilot entfernt (Unternehmensabonnement)

- Wie man Microsoft 365 Copilot deaktiviert (persönliches oder Familien-Abonnement)

- Wie man Copilot-Symbole in Windows 11 ausblendet

- Wie man Daten- und Personalisierungsfunktionen in der Copilot-Web-App deaktiviert

- Wie man das Modelltraining des Gaming Copilot deaktiviert

- Wie du dein Copilot-Konto löschst

- Was ist Microsoft Copilot?

- Was sind die Risiken für die Privatsphäre bei Microsoft Copilot?

- Was sind die Sicherheitsrisiken bei Microsoft Copilot?

- Eine private Alternative zu Copilot und Microsoft

Wie man Copilot-KI ausschaltet

Abhängig davon, wie du Copilot verwendest, kannst du ihn wie folgt von deinem Computer entfernen, seine Einstellungen anpassen oder seine Präsenz reduzieren:

Wie man Microsoft 365 Copilot entfernt (Unternehmensabonnement)

Wenn du ein Unternehmensbenutzer bist, gehe zu Einstellungen → Apps → Installierte Apps, wähle Copilot aus und klicke auf Deinstallieren.

IT-Administratoren können die Copilot-App mit dem folgenden Befehl in PowerShell entfernen:

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

Wie man Microsoft 365 Copilot deaktiviert (persönliches oder Familien-Abonnement)

- Öffne eine beliebige Microsoft 365-App (Word, Excel, PowerPoint oder OneNote).

- Gehe zu Datei → Optionen → Copilot.

- Entferne das Häkchen bei Copilot aktivieren.

Wiederhole diese Schritte für jede Microsoft-App, in der du Copilot deaktivieren möchtest.

Wenn die Einstellung „Copilot aktivieren“ in keiner der Microsoft-Apps existiert:

- Öffne Word, Excel, PowerPoint oder OneNote.

- Gehe zu Datei → Konto → Konto-Privatsphäre → Einstellungen verwalten → Verbundene Erfahrungen.

- Entferne das Häkchen bei Erfahrungen aktivieren, die deine Inhalte analysieren.

- Starte die App neu.

Du musst dies nur einmal tun, da die neue Privatsphäre-Einstellung automatisch auf alle mit deinem Konto verknüpften Microsoft 365-Apps angewendet wird.

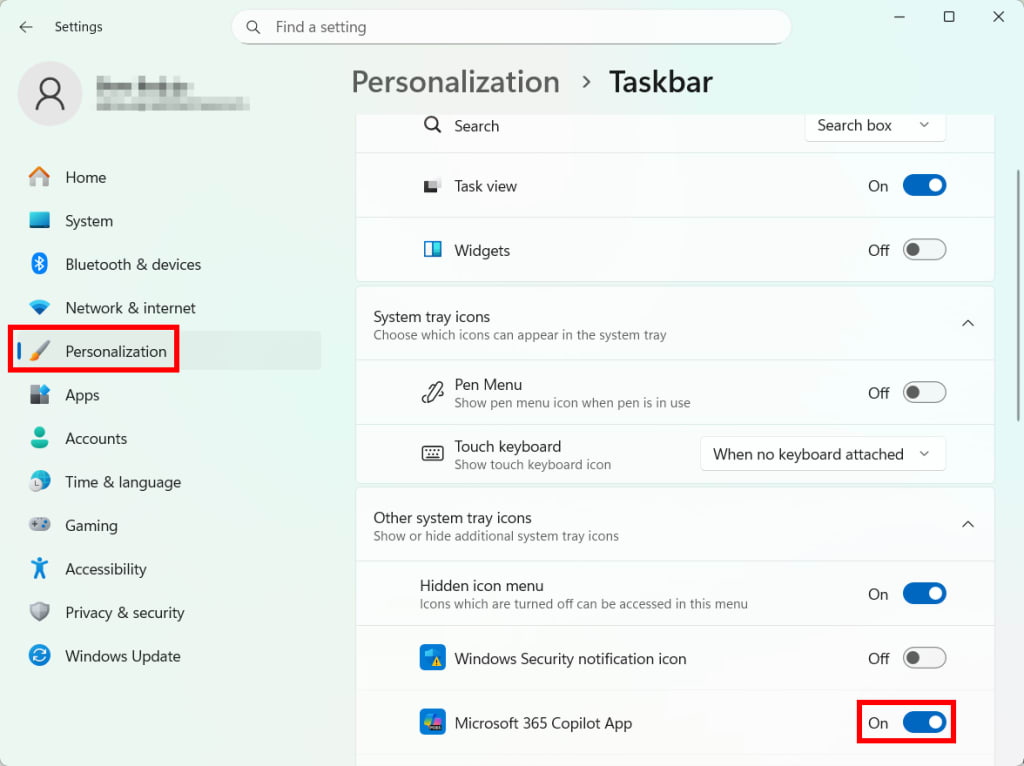

Wie man Copilot-Symbole in Windows 11 ausblendet

Du kannst Copilot-Symbole in Windows ausschalten, aber du kannst die Funktion nicht vollständig von deinem Computer entfernen. Diese Schritte deaktivieren nur die visuellen und Personalisierungselemente von Copilot, sodass du weiterhin auf die App zugreifen kannst.

So blendest du die Copilot-Schaltfläche in deiner Taskleiste aus:

- Gehe zu Einstellungen → Personalisierung → Taskleiste.

- Finde Copilot und schalte es aus.

Wenn du Apps verwendest, die Copilot integriert haben, musst du es in jeder App separat deaktivieren. Gehe zum Beispiel in Notepad zu Einstellungen → KI-Funktionen und schalte Copilot aus.

- Starte deinen Computer neu, damit die Änderungen wirksam werden.

Wie man Daten- und Personalisierungsfunktionen in der Copilot-Web-App deaktiviert

- Wähle deinen Profilnamen oder dein Foto → dein Konto → Privatsphäre.

- Schalte die folgenden Optionen aus:

- Modelltraining mit Text

- Modelltraining mit Stimme

- Personalisierung und Gedächtnis

- Wähle Gedächtnis löschen, um sofort zu entfernen, was Copilot über dich weiß.

- Klicke auf Verlauf exportieren oder löschen. Dies öffnet eine Browser-Seite, auf der du dich mit dem Microsoft-Konto anmelden musst, das du für Copilot verwendest.

- Wähle Gesamten Aktivitätsverlauf löschen für jede dieser Kategorien:

- Copilot-App-Aktivitätsverlauf

- Copilot in Microsoft 365-Apps

- Copilot in Windows-Apps

- Wähle deinen Profilnamen oder dein Foto → Connectors.

- Schalte alles aus, einschließlich OneDrive, Outlook, Gmail, Google Drive und Google Kalender.

Beachte, dass es keine Möglichkeit gibt, dies rückgängig zu machen, wenn deine Daten bereits für das Modelltraining verwendet wurden.

Wie man das Modelltraining des Gaming Copilot deaktiviert

- Drücke unter Windows Win + G, um die Game Bar zu öffnen.

- Gehe zu Einstellungen → Privatsphäre-Einstellungen → Gaming Copilot.

- Schalte Modelltraining mit Text aus.

- Um das Gaming-Copilot-Widget auszublenden, entferne es aus der Liste der Game-Bar-Widgets.

Derzeit gibt es keine Möglichkeit, Gaming Copilot vollständig aus der Xbox Game Bar zu entfernen. Außerdem kannst du nicht verhindern, dass es deine Sprachinteraktionen verwendet, um seine KI-Modelle zu trainieren. Wenn dir Privatsphäre wichtig ist, ist es am sichersten, überhaupt nicht mit Gaming Copilot zu interagieren.

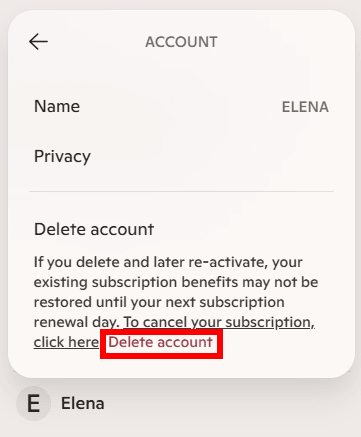

Wie du dein Copilot-Konto löschst

Wähle in der Copilot-Web-App deinen Profilnamen oder dein Foto → dein Konto → Konto löschen.

Das Löschen deines Copilot-Kontos löscht nicht dein Microsoft-Konto, und du kannst Copilot weiterhin verwenden, ohne dich anzumelden.

Wenn du dich lieber überhaupt nicht auf Copilot verlassen möchtest, erwäge den Wechsel zu einem Privatsphäre-KI-Assistenten(neues Fenster), der deine Daten niemals protokolliert, sie für das Modelltraining verwendet oder mit Dritten teilt.

Was ist Microsoft Copilot?

Copilot ist Microsofts Reihe von KI-Assistenten, die in seine Produkte und Dienste wie Word, Excel, PowerPoint, Outlook, Teams und Windows integriert sind. Es verwendet große Sprachmodelle (LLMs), die auf Microsofts eigenen KI-Technologien und den GPTs von OpenAI basieren – wie GPT-4o, das auch ChatGPT antreibt.

Wie LLMs kann Copilot dir helfen, produktiver, kreativer und effizienter zu sein, indem es natürlichsprachliche Prompts versteht, Daten analysiert, Inhalte generiert und zusammenfasst und Vorschläge basierend auf dem Kontext liefert.

Microsoft stellt Copilot in mehreren Versionen zur Verfügung, je nachdem, ob du es privat oder beruflich nutzt, darunter:

- Microsoft Copilot – ein kostenloser persönlicher KI-Assistent für alltägliche Aufgaben. Er ist als Windows 11-App (standardmäßig installiert), Web-App und macOS-App verfügbar.

- Gaming Copilot – ein kostenloser persönlicher KI-Assistent für Windows-Gaming, der Screenshots macht, um zu verstehen, was in einem Spiel passiert, und Tipps zu geben, ähnlich wie Recall Schnappschüsse deiner Desktop-Aktivität macht.

- Microsoft 365 Copilot – integriert sich in Word, Excel, PowerPoint, Outlook und Teams, um deine Daten über Microsoft Graph zu nutzen, eine Plattform, die deine Daten wie E-Mails, Kalender und Dokumente verbindet.

Was sind die Risiken für die Privatsphäre bei Microsoft Copilot?

Microsoft behält starke Vorkehrungen für die Privatsphäre für Copilot in Unternehmenseinstellungen bei, aber Verbraucherkonten sehen sich einer ganz anderen Realität gegenüber(neues Fenster):

Deine Daten könnten für Werbung und Profiling verwendet werden

Copilot-Dienste in Microsoft-Verbraucherkonten sind mit dem Werbe-Ökosystem von Microsoft verbunden. Das bedeutet, dass deine Interaktionen die Anzeigen und Empfehlungen beeinflussen können, die du siehst. Wenn du Copilot beispielsweise nach Reiseangeboten fragst, könntest du später Flug- oder Hotelanzeigen sehen.

Obwohl du personalisierte Anzeigen in deinen Microsoft-Konto-Privatsphäre-Einstellungen ausschalten kannst, behält das Unternehmen diese Interaktionsdaten dennoch und kann sie in anonymisierter Form für andere Zwecke verwenden, wie zum Beispiel zur Verbesserung des Anzeigen-Targetings für andere Copilot-Benutzer mit ähnlichen Profilen wie deinem.

Du behältst das Eigentum, aber Microsoft kann deine Daten trotzdem verwenden

Obwohl Microsoft sagt, dass du das Eigentum an deinen Inhalten behältst, bedeutet die Nutzung von Copilot, dass du dem Unternehmen weitreichende Rechte daran gewährst, einschließlich des Rechts, deine Daten zu „kopieren, zu verteilen, zu übertragen, öffentlich anzuzeigen, öffentlich aufzuführen, zu bearbeiten, zu übersetzen und neu zu formatieren“ und diese Rechte an Dritte weiterzugeben.

Wenn du zum Beispiel ein Autor bist, der Auszüge aus einer unveröffentlichten Geschichte in Copilot einfügt, um um Korrekturlesen oder stilistisches Feedback zu bitten, wird dieser Text technisch gesehen Teil des Materials, das Microsoft gemäß seinen Nutzungsbedingungen verarbeiten und verwenden darf. Dein unveröffentlichtes geistiges Eigentum kann also außerhalb deiner direkten Kontrolle verwendet werden, selbst wenn es niemals öffentlich wird.

Deine Daten könnten verarbeitet und für KI-Training verwendet werden

Daten aus deinen Copilot-Prompts und -Antworten können gesammelt, protokolliert und von Microsoft für KI-Training analysiert werden. Es gibt keine Garantie, dass deine sensiblen oder persönlichen Daten aus Trainingsdatensätzen ausgeschlossen werden.

Wie bei den meisten KI-Assistenten benötigt Copilot riesige Mengen an Informationen, um weiter zu lernen und seine Antworten zu verfeinern – selbst wenn dieser Prozess in Grauzonen des geistigen Eigentums abdriften kann. Ein aktuelles Beispiel ist eine Reihe von US-Klagen(neues Fenster), die von Autoren und großen Nachrichtenagenturen eingereicht wurden, die behaupten, dass Microsoft und sein Partner OpenAI ihre urheberrechtlich geschützten Werke ohne Erlaubnis verwendet haben, um KI-Modelle wie Copilot und ChatGPT zu trainieren. OpenAI selbst hat öffentlich eingeräumt(neues Fenster), dass es „unmöglich ist, die heutigen führenden KI-Systeme ohne die Verwendung urheberrechtlich geschützter Materialien zu trainieren“.

Personen könnten deine sensiblen Daten sehen

Microsoft-Mitarbeiter überprüfen möglicherweise deine Copilot-Eingaben und -Ausgaben – einschließlich allem, was du tippst oder als Dateianhänge hochlädst –, um den Dienst zu verbessern, schädliche Inhalte zu moderieren oder wenn du dich entscheidest, Feedback zu geben. Wenn dir der Gedanke daran unangenehm ist, solltest du vermeiden, sensible Informationen wie personenbezogene Daten oder Geschäftsgeheimnisse einzugeben.

Connectors legen deine Daten gegenüber Drittanbietern offen

Connectors ermöglichen es Copilot, sich mit Microsoft-Produkten (wie OneDrive oder Outlook) und Drittanbieter-Diensten (wie Google Drive) zu verknüpfen, sodass er Informationen aus mehreren Quellen abrufen kann. Wenn du beispielsweise Copilot bittest, alle in Google Drive gespeicherten Besprechungsnotizen zusammenzufassen, durchsucht er deine Drive-Dateien und liefert eine Zusammenfassung.

Aber wenn du einen Connector aktivierst, erlaubst du Copilot auch, Informationen mit diesem anderen Dienst auszutauschen. Im Fall von Google Drive erhält Copilot zwar Zugriff auf die Dateistruktur, Namen, Zeitstempel und Inhalte deines Drives, aber Google erhält auch bestimmte Details, die mit deinem Microsoft-Konto verknüpft sind, wie dein Profilfoto, deinen Namen oder deine E-Mail-Adresse. Deine wertvollen Daten leben jetzt in beiden Ökosystemen (Microsoft und Google), was ein klareres, vollständigeres Profil von dir über Plattformen hinweg erstellt.

Deine Daten könnten unter US-Gerichtsbarkeit Grenzen überschreiten

Abhängig davon, wo du wohnst, speichert Microsoft deine Copilot-Daten und Interaktionen möglicherweise in deiner Region. Zum Beispiel könnten Europäer ihre Daten innerhalb der EU gespeichert haben. Aber deine Daten bleiben möglicherweise nicht immer dort. Trotz der Verpflichtungen zur EU-Datengrenze(neues Fenster) des Unternehmens kann aus technischen oder kapazitätsbedingten Gründen immer noch eine Verarbeitung außerhalb deiner Region stattfinden. Und da Microsoft ein US-Unternehmen ist, unterliegt es US-Gesetzen wie dem CLOUD Act, was bedeutet, dass US-Behörden Zugriff auf deine Daten verlangen könnten (egal wo sie gespeichert sind), manchmal ohne einen richterlichen Beschluss zu benötigen.

Microsoft überwacht Copilot-Chatdaten genau

Microsoft analysiert Copilot-Interaktionen in großem Maßstab, um zu verstehen, wie Menschen den Assistenten im Laufe der Zeit nutzen. Im Copilot Usage Report 2025(neues Fenster) untersuchten KI-Forscher 37,5 Millionen Copilot-Unterhaltungen, um Nutzungsmuster zu identifizieren, und merkten an, dass weitere Berichte veröffentlicht werden, sobald mehr Daten verfügbar sind. Microsoft ist nicht das einzige Unternehmen, das dies tut, da sein Partner OpenAI auch Verbrauchernutzungsdaten(neues Fenster) für ChatGPT veröffentlicht.

Microsoft sagt, diese Daten wurden de-identifiziert und auf Zusammenfassungen auf hoher Ebene reduziert, aber das beseitigt Datenschutzrisiken nicht vollständig. Forschungen(neues Fenster) haben wiederholt gezeigt, dass vermeintlich anonyme Daten oft re-identifiziert werden können, wenn sie mit anderen Dingen wie Zeitstempeln, Geräteeigenschaften oder Standortsignalen kombiniert werden. Und da Copilot an ein kontobasiertes Ökosystem gebunden ist, das Windows, Microsoft 365, Bing, Edge und Werbedienste umfasst, machen diese dienstübergreifenden Verbindungen eine Wiederverknüpfung im Laufe der Zeit einfacher.

Außerdem ist unklar, wie lange die ursprünglichen, identifizierbaren Copilot-Unterhaltungsdaten vor der De-Identifizierung gespeichert bleiben oder wie sie geschützt sind. Wenn Rohdaten auf den Servern von Microsoft liegen, können sie Risiken wie unbefugtem Zugriff, Insider-Bedrohungen oder Datenlecks ausgesetzt sein.

Was sind die Sicherheitsrisiken von Microsoft Copilot?

Da Microsoft auf durchschnittlich drei Millionen sensible Datensätze(neues Fenster) für jede Organisation zugreifen kann, ist es wichtig, die Sicherheitsrisiken zu verstehen, die es einführen kann, insbesondere wenn du planst, es für dein Unternehmen zu nutzen:

- Im Juni 2025 entdeckten Forscher EchoLeak (CVE-2025-32711(neues Fenster)), eine Zero-Click-Schwachstelle in Microsoft 365 Copilot, die es Angreifern ermöglichte, Daten ohne jegliche Benutzeraktion zu stehlen. Indem sie bösartige Anweisungen und Links in einer normalen E-Mail versteckten, konnten Angreifer Copilot dazu bringen, diesen Befehlen zu folgen, auf diese Links zuzugreifen und Teile der Benutzerdaten an einen externen Server zu senden. Die Schwachstelle wurde gepatcht, aber es ist ein Beispiel dafür, wie die Integration von KI-Assistenten wie Copilot in Kernsysteme – und ihnen weitreichenden Zugriff auf E-Mails, Dokumente und interne Daten zu geben – sie zu Insider-Bedrohungen machen kann, wenn sie manipuliert oder falsch konfiguriert werden.

- Im August 2024 entdeckte eine Cybersicherheitsfirma(neues Fenster) eine kritische Sicherheitslücke zur Offenlegung von Informationen in Microsoft Copilot Studio, die es benutzerdefinierten Copiloten erlaubte, schwache Schutzmaßnahmen auszunutzen und sensible Informationen (wie Service-Token und Datenbankschlüssel) zu erhalten, um sich weiter in einem internen System zu bewegen. Microsoft hat das Problem behoben.

- Im Oktober 2025 deckten Sicherheitsforscher(neues Fenster) eine Phishing-Technik namens CoPhish auf, die Microsoft Copilot Studio missbraucht, um bösartige Anmeldeseiten völlig legitim aussehen zu lassen. Angreifer können einen Copilot Studio-Agenten erstellen, dessen Anmelde-Button Opfer auf eine gefälschte OAuth-Zustimmungsseite umleitet, und dann den Agenten-Link (der auf einer vertrauenswürdigen Microsoft-Domain gehostet wird) teilen, um Benutzer dazu zu verleiten, Zugriff zu gewähren. Sobald die Zustimmung erteilt ist, kann der Angreifer Token erhalten, die es ihm ermöglichen, Daten wie E-Mails, Chats, Kalender und Notizen zu lesen, zu schreiben oder zu senden. Microsoft arbeitet noch an diesem Problem.

Eine private Alternative zu Copilot und Microsoft

Wenn du dich unwohl fühlst, wie tief Copilot in Windows integriert ist und wie viele Daten Microsoft über seine KI-Dienste sammelt – aber trotzdem den Komfort eines KI-Chatbots möchtest – wechsle zu Lumo, unserem privaten KI-Assistenten(neues Fenster). Lumo ist in Europa beheimatet und sammelt weder deine Daten noch trainiert er damit, zeigt dir keine Werbung an, führt keine Protokolle und teilt deine Informationen mit niemandem.

Und wenn du bereit bist, das Microsoft-Ökosystem vollständig zu verlassen, kannst du mit unserem verschlüsselten Ökosystem deinen eigenen privaten digitalen Arbeitsplatz aufbauen. Du kannst Folgendes nutzen:

- Proton Mail und Calendar für sichere kostenlose E-Mails und private Terminplanung

- Proton Pass für sichere Passwortverwaltung

- Proton Drive für verschlüsselten Cloud-Speicher und Dateifreigabe

- Proton VPN zum Schutz deines Internetverkehrs(neues Fenster)

Jeder Proton-Dienst ist standardmäßig so gebaut, dass er deine Privatsphäre schützt, unter Verwendung von Ende-zu-Ende-Verschlüsselung, sodass niemand außer dir auf deine Daten zugreifen kann – nicht einmal wir.